'Law enforcement & AI': desafíos e incertidumbres en la relación trasatlántica

Sus oportunidades son inmensas, pero también lo son sus riesgos...

La semana pasada -últimos días de febrero, 2020- tuve el honor de presidir una Delegación especial de la Comisión de Libertades, Justicia & Interior (Com LIBE) del Parlamento Europeo (PE) en los Estados Unidos.

En su capital federal, Washington DC, sostuvimos una interlocución con el Departamento de Estado, con el FBI, con el Congreso de EEUU en Capitol Hill (Cámara de Representantes y Senado) y con la Agencia federal de supervisión de los Servicios de Vigilancia Exterior (FISA: Foreign Intelligence Surveillance Act). En una última jornada en Boston, tuvimos la oportunidad de escuchar, de primera mano, presentaciones en directo de los últimos avances en Inteligencia Artificial en centros de investigación avanzada del MIT y de la Universidad de Harvard, por parte de cualificados exponentes de su comunidad científica.

El objetivo de la misión de la Com LIBE era, cuanto menos, triple: a) intercambiar nuestras experiencias y puntos de vista respecto de los modelos UE y EEUU de “Protección de Datos y Privacy”; b) repasar conjuntamente la agenda de nuestra colaboración transatlántica en materia de Law Enforcement, así como el intercambio de información, inteligencia y cooperación judicial penal contra la criminalidad grave transnacional y contra el terrorismo (con especial detenimiento en el desafío relativo a qué hacer con los llamados “combatientes desplazados y (en su caso) repatriados” (Foreign Fighters); c) conocer de primera mano los más reciente desarrollos en Artificial Intelligence (AI).

¿Pero, cuál era su contexto? Con carácter general, era encuadrar la actual agenda legislativa del PE en el Programa de Trabajo (Working Program) de la Comisión Von Der Leyen (VDL) para la Legislatura 2019-2024, una de cuyas prioridades estratégicas estriba, declaradamente, en emplazar a la UE como un actor global en la Era Digital y en el acometimiento de inversiones, públicas y privadas, en conocimiento y ciencia de Inteligencia Artificial (AI). En un nivel más concreto subyace, además, la conciencia de la denominada Relación Transatlántica entre EEUU y la UE. Pero también la alerta ante la dificultad impuesta a esa Relación y Diálogo Transatlántico por la divergencia de nuestros patrones constitucionales y jurídicos de protección de libertades esenciales para el constitucionalismo y nuestros respectivos modelos de Estado de derecho (libertad de expresión; privacidad; protección de datos; tutela judicial efectiva y acceso a la justicia). Y la preocupación europea, fundada, ante la complicación que añade a nuestra relación el carácter disruptivo impuesto por la Presidencia Trump sobre los términos históricos en que la habíamos comprendido desde el fin de la II Guerra Mundial y el arranque del proceso de integración europea.

Vista la envergadura de estos retos, el repaso a sus problemas quiso ser exhaustivo y muy franco en sus contrastes. Una oportunidad para oponer abiertamente tanto las exigencias y herramientas de nuestras respectivas culturas jurídicas como las valoraciones acerca de sus impactos en los procedimientos legislativos en curso para actualizar las respuestas, poniendo en hora nuestros instrumentales de protección de datos, de investigación de los delitos y de garantía de la seguridad de la ciudadanía frente a amenazas globales de una sofisticación tecnológica y científica sin precedentes en la historia (ciberseguridad y cibercriminalidad).

Particular atención merece seguramente el capítulo científico, en el que nos detuvimos en nuestras conversaciones en el MIT y en el Campus de Harvard. La premisa de partida, tal y como la expusieron los investigadores a quienes escuchamos, es la que “todo lo que pueda hacerse desde un punto de vista científico y/o tecnológico simplemente se hará”. Más pronto que tarde, alguien simplemente lo hará; a lo que se anuda enseguida la preferencia (supuestamente moralizante) de que “mejor será que lo hagan antes los buenos (quienes actúen vinculados al imperio de la ley democráticamente legitimada) antes de lo que lo hagan los malos” (crimen organizado; Rogue States; actores no estatales animados por el lucro o métodos terroristas...)

La cuestión clave a debatir será, a partir de ahí, qué pueden hacer los poderes legislativos democráticamente legitimados (¡y el PE sin duda lo es!) para responder a ese reto, ahormando los desarrollos de la tecnología y la ciencia para proteger derechos y preservar valores sin los que nuestra civilización resultaría irreconocible.

Y, sin embargo, la experiencia prueba una y otra vez que la legislación suele llegar a esa cita un capítulo demasiado tarde, a riesgo de su obsolescencia o de su ineficacia para mantener el ritmo atosigado y vertiginoso de los avances tecnológicos.

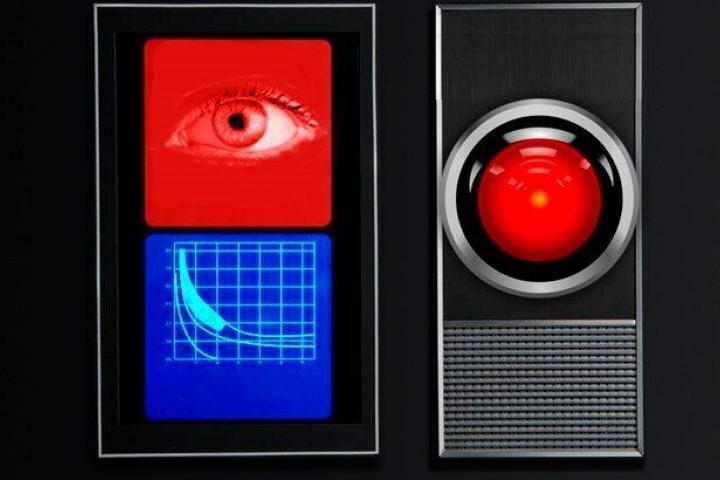

El caso de la AI resulta, al mismo tiempo, expresivo y pavoroso. Sus oportunidades son inmensas (piénsese en sus aplicaciones para la investigación de delitos y averiguación de responsabilidades penales), pero también lo son sus riesgos: la globalización de la facial recognition (reconocimiento del rostro) y de la voice recognition (el reconocimiento de la voz humana, individualizada y única; de su timbre, dicción, cadencia, acento...), así como de otras pautas de detección de personas y construcción de perfiles, podrían erigirse tanto en herramientas de investigación criminal como de inaceptable profiling discriminatorio, llegando incluso a establecer prognosis de eventuales tendencias a cometer ciertos actos (precrime), con prácticas y aplicaciones que resultarían aberrantemente intrusivas y una violación flagrante de la dignidad personal.

El desafío se acrecienta cuando constatamos que la misma tecnología que auspicia estos desarrollos puede subvertir su objeto para cimentar un Deep Fake (¨Falso profundo” y total) globalizado y terrible: porque la automación de nuestros datos personales permite ya construir imágenes y sonidos virtuales, falsos de principio a fin, que pueden llegar a suplantar nuestra identidad hasta el punto de hacer creer en su veracidad -y de hacerlo globalmente-, dejando un rastro indeleble en el éter cibernético que imponga la ilusión mentirosa de que hayamos hecho o dicho cosas que nunca jamás sucedieron.

La Comisión VDL arranca su compromiso con la presentación de un Libro Blanco (White Paper) sobre la estrategia de Inteligencia Artificial. Su despliegue afectará, en una pluralidad de iniciativas legislativas, a un amplio abanico de Comisiones del PE. Pero afectará, sin duda, a la agenda a acometer por la Comisión LIBE, no sólo por la amplitud de su espectro de competencias legislativas sobre el total del PE, sino por su singular dedicación al campo de la garantía de derechos en igualdad (con prohibición de toda forma de discriminación), consagrados en la Carta de Derechos Fundamentales de la UE (CDFUE), que entró en vigor en 2009 con el mismo valor jurídico que el Tratado de Lisboa, y que es vinculante, por tanto, para las instituciones y para los estados miembros de la UE.

Para un próximo post dejo mis impresiones sobre la apasionante campaña demócrata para elegir a la persona que deberá enfrentarse a Trump en las presidenciales en noviembre de 2020.